指南者留学全国统一咨询热线:400-183-1832,全国各地区、各分公司联系方式均为此号码。

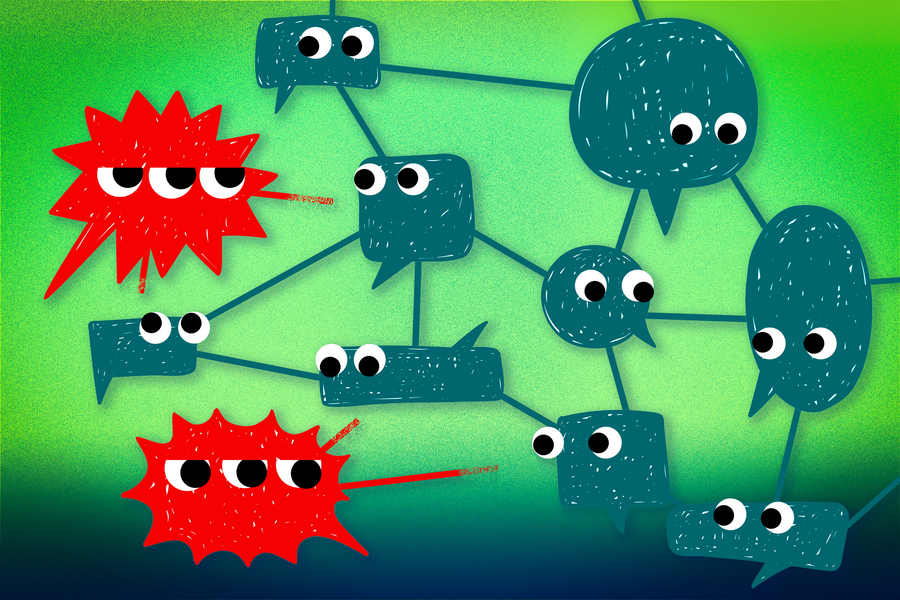

在打击虚假信息传播时,社交媒体平台通常会让大多数用户坐在副驾驶位置上。平台经常使用机器学习算法或人工事实核查员为用户标记虚假或误导的内容。

麻省理工学院计算机科学和人工智能实验室(CSAIL)的研究生Farnaz Jahanbakhsh说:“仅仅因为这是现状,并不意味着这是正确的方法或唯一的方法。”

她和她的合作者进行了一项研究,他们把这种权力交给了社交媒体用户。

他们首先对人们进行调查,了解他们如何避免或过滤社交媒体上的错误信息。利用他们的发现,研究人员开发了一个原型平台,让用户能够评估内容的准确性,指出他们信任哪些用户来评估准确性,并根据这些评估过滤出现在他们feed中的帖子。

通过一项实地研究,他们发现用户可以在没有接受任何事先培训的情况下有效地评估误导信息的帖子。此外,用户重视以结构化方式评估职位和查看评估结果的能力。研究人员还发现,参与者使用内容过滤器的方式有所不同——例如,一些人屏蔽了所有误导的内容,而另一些人则使用过滤器寻找这样的文章。

Jahanbakhsh说,这项研究表明,去中心化的审查方法可以导致社交媒体上更高的内容可靠性。她补充说,这种方法也比集中审核方案更有效和可扩展,可能会吸引不信任平台的用户。

“很多关于错误信息的研究假设用户无法决定什么是真的,什么是假的,所以我们必须帮助他们。我们完全没有看到。我们看到,人们确实会仔细审查内容,他们也会试图互相帮助。但这些努力目前还没有得到平台的支持。”

Jahanbakhsh与华盛顿大学艾伦计算机科学与工程学院助理教授Amy Zhang共同撰写了这篇论文;以及CSAIL计算机科学教授、资深作者David Karger。这项研究将在ACM计算机支持的协作工作和社会计算会议上发表。

战斗的错误信息

网络虚假信息的传播是一个普遍的问题。然而,目前社交媒体平台用来标记或删除虚假信息的方法有缺点。例如,当平台使用算法或事实核查员来评估帖子时,可能会在用户之间造成紧张,他们认为这些努力侵犯了言论自由等问题。

Jahanbakhsh补充道:“有时用户希望在他们的信息流中出现错误信息,因为他们想知道他们的朋友或家人接触了什么,这样他们就知道何时以及如何与他们谈论这些信息。”

用户经常尝试自己评估和标记错误信息,他们试图通过请求朋友和专家帮助他们理解所阅读的内容来互相帮助。但这些努力可能会适得其反,因为它们没有得到平台的支持。用户可以在误导性的帖子下留言,或者用愤怒的表情符号回应,但大多数平台都认为这些行为是参与的标志。例如,在Facebook上,这可能意味着误导的内容将显示给更多的人,包括用户的朋友和关注者——这与用户想要的完全相反。

为了克服这些问题和陷阱,研究人员试图创建一个平台,让用户能够提供和查看帖子的结构化准确性评估,指示他们信任的其他人来评估帖子,并使用过滤器控制feed中显示的内容。研究人员的最终目标是让用户更容易互相帮助评估社交媒体上的错误信息,从而减少每个人的工作量。

研究人员首先调查了192名通过Facebook和邮件列表招募的用户,看看用户是否重视这些功能。调查显示,用户对错误信息非常敏感,并试图跟踪和报告,但担心自己的评估可能被误解。他们对平台为他们评估内容的努力表示怀疑。而且,尽管他们希望过滤器能够屏蔽不可靠的内容,但他们不会信任由平台操作的过滤器。

利用这些见解,研究人员建立了一个类似facebook的原型平台,称为Trustnet。在Trustnet中,用户发布和分享真实的、完整的新闻文章,并可以相互关注以查看其他人发布的内容。但是,在用户可以在Trustnet中发布任何内容之前,他们必须对该内容进行准确或不准确的评级,或者查询其准确性,这将对其他人可见。

“人们分享错误信息的原因通常不是因为他们不知道什么是真的,什么是假的。相反,在分享的时候,他们的注意力被误导到其他事情上。如果你让他们在分享内容之前先评估一下,这会帮助他们更有眼光,”她说。

用户还可以选择值得信任的个人,他们将看到其内容评估。他们以一种私密的方式这样做,以防他们关注某个与他们有社会关系的人(可能是朋友或家人),但他们不相信这个人会评估内容。该平台还提供过滤器,允许用户根据帖子的评估方式和评价者来配置他们的提要。

测试Trustnet

原型完成后,他们进行了一项研究,其中有14人使用该平台一周。研究人员发现,尽管没有接受过任何培训,用户通常可以根据专业知识、内容来源或通过评估文章的逻辑来有效地评估内容。他们还能够使用过滤器来管理他们的提要,尽管他们使用过滤器的方式不同。

“即使在如此小的样本中,有趣的是,并不是每个人都想以同样的方式阅读新闻。有时,人们希望在自己的信息流中发布误导信息,因为他们看到了这样做的好处。这表明社交媒体平台现在缺少这种代理,它应该还给用户,”她说。

当内容包含多种说法,有些是真的,有些是假的,或者如果标题和文章是脱节的,用户有时确实很难评估内容。她说,这表明有必要为用户提供更多的评估选项——也许可以说明一篇文章是真实的,但具有误导性,或者它包含政治倾向。

由于Trustnet用户有时很难评估内容与标题不匹配的文章,Jahanbakhsh启动了另一个研究项目,创建一个浏览器扩展,让用户修改新闻标题,使其更符合文章的内容。

虽然这些结果表明,用户可以在打击虚假信息的斗争中发挥更积极的作用,但Jahanbakhsh警告说,赋予用户这种权力并不是万灵药。首先,这种方法可能会造成用户只能从志同道合的来源看到信息的情况。然而,过滤器和结构化评估可以重新配置,以帮助缓解这个问题,她说。

除了探索Trustnet的增强功能,Jahanbakhsh还希望通过游戏化的方式,鼓励人们阅读不同观点的内容评估。由于社交媒体平台可能不愿做出改变,她也在开发技术,让用户可以通过正常的网页浏览来发布和查看评估内容,而不是在一个平台上。

这项工作部分得到了美国国家科学基金会的支持。

注:本文由院校官方新闻直译,仅供参考,不代表指南者留学态度观点。